La IA no es un fenómeno nuevo. La humanidad, desde sus inicios, ha intentado crear máquinas y autómatas, bien para ponerlas a nuestro servicio, o para extender nuestras capacidades humanas. Muchas de estas historias reflejan la admiración por estas creaciones y, al mismo tiempo, el temor a la pérdida de control de las tecnologías avanzadas. Podríamos recordar algunos mitos griegos, como la creación de Talos, el gigante de bronce muerto por Medea, o la estatua en marfil de Galatea a la que Pigmalión dio vida. En la Edad Media hay otras leyendas acerca de la creación de seres con vida, como el enigmático Baphomet de los templarios o los homúnculos de Paracelso. Agreguemos las tradiciones judías sobre la creación de un ser de barro llamado Gólem, que era animado por medio de un ritual mágico. En la época moderna tenemos la monstruosa creación del doctor Víctor Frankestein, en la novela de Mary Shelley, o el niño de madera Pinocho, creado por el carpintero Gepetto en la novela de Carlo Collodi. En ambos casos, se hace una llamada a la responsabilidad de la ciencia y de la acción humana, para mantenerse dentro de en unas pautas éticas, que veremos que es un elemento fundamental.

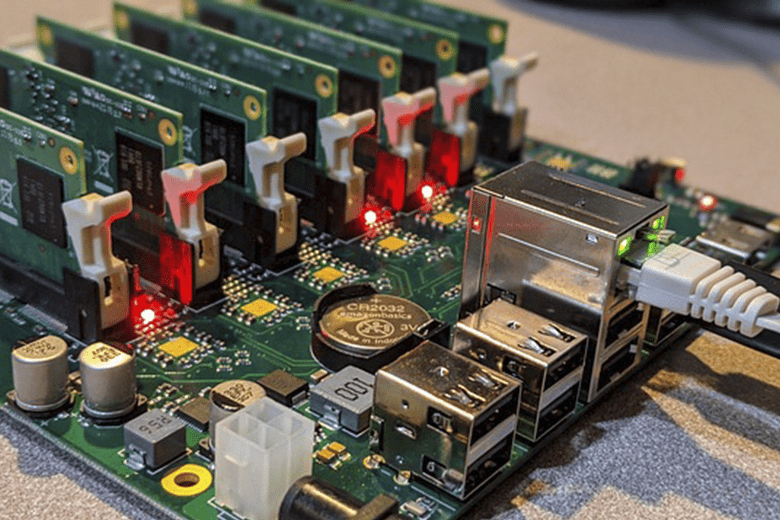

También se crearon otros autómatas, que es la palabra que utilizaban los griegos, artificios o ingenios que funcionaban como el mecanismo de un reloj, aparentando un comportamiento autónomo o inteligente. En el siglo XX surgen los primeros «robots», utilizando un término proveniente del checo que indica un trabajo forzado. Curiosamente, Aristóteles defendía en la Política[1] la fabricación de autómatas para la realización de tareas mecánicas, pues podía traer la abolición de la esclavitud por hacerla innecesaria.

La IA se empezó a crear en los años 1950. En su progreso paulatino siempre se trató de imitar la inteligencia humana: primero, algoritmos o instrucciones lógicas para llegar a un objetivo; luego, sistemas expertos, basados en conocimientos aceptados como correctos; sistemas de aprendizaje automático, para no depender de una colección limitada de conocimientos; redes neuronales para tratar con datos complejos y relaciones no lineales; visión artificial para el reconocimiento de patrones y así emular nuestro contacto con el entorno; y, por fin, el procesamiento del lenguaje natural que permite interactuar con los seres humanos. Todavía no está muy perfeccionada, pero el rápido avance que está teniendo esta tecnología no deja de sorprendernos. Ya se pueden generar voces, fotos e incluso vídeos que simulan la apariencia humana. Con ellos es posible que en un futuro cercano perdamos nuestra capacidad de distinguir los hechos de la ficción creada por la IA, sin forma de poder dilucidarlo.

Algunas de las creaciones que mencionamos nos han causado temor, porque pueden ser más poderosas que nosotros, nos pueden reemplazar, se pueden utilizar para dominar el mundo, o se parecen tanto a nosotros que nos dan miedo. Todas estas desviaciones pueden provocar un problema de convivencia con las máquinas.

Cuestiones éticas

Además, se nos plantean una serie de problemas éticos relacionados con la IA, como por ejemplo:

- La discriminación algorítmica, provocada porque los sistemas de IA pueden haber sido entrenados con datos que incluyen prejuicios culturales y sociales. Esto puede conducir a la discriminación e injusticia en áreas como el empleo, la vivienda y los préstamos. Hay muchos casos documentados de ello[2].

- La falta de transparencia en los algoritmos, de forma que podamos entender cómo se toman las decisiones y en qué se basan, para que se pueda auditar su uso. Muchos algoritmos de IA son opacos y difíciles de entender, lo cual es especialmente problemático en áreas como la atención médica, donde las decisiones de la IA pueden afectar la salud y el bienestar de las personas.

- ¿Quién es responsable cuando un algoritmo de IA toma una decisión errónea? ¿Es el programador, la empresa que lo implementó o el algoritmo mismo? Si entendemos por «hacerse responsable» el tener un elevado criterio del deber o del compromiso con las normas establecidas y asumir las consecuencias positivas o negativas de nuestros actos, vemos que hay un nexo entre responsabilidad y conciencia, por lo que de nuevo se nos plantea un problema con las acciones de la IA.

- ¿Es admisible que haya armas autónomas, por ejemplo drones, que realicen operaciones policiales o militares? Esto podría llevar a la escalada de conflictos y a la pérdida de control humano sobre el uso de la fuerza militar. El relato fantástico de la saga de Terminator se vuelve realidad si hay una «Skynet» capaz de controlar el arsenal militar de los Estados Unidos con independencia de los humanos.

- Debemos asegurar que los seres humanos mantienen el control y la responsabilidad de las decisiones que afectan a su bienestar o su vida en áreas críticas como la medicina, la justicia social, la seguridad nacional, la defensa, etc. No es aconsejable dejar el control absoluto de sus acciones a la IA.

La IA se está adentrando en un terreno en el que nos creíamos insuperables. Nos considerábamos los únicos animales racionales. En muchas culturas y tradiciones se destacó la importancia de lo mental para identificarnos como humanos. Pero las capacidades humanas han sido progresivamente emuladas y superadas por las máquinas. Ya no es solo la fuerza o las capacidades físicas. Primero fue el cálculo matemático, y no nos sorprende que cualquier pequeña calculadora (o nuestro teléfono móvil) sea más rápida que nosotros en una división de diez cifras. Luego, la memoria: ahora un pequeño chip puede almacenar más libros que la célebre Biblioteca de Alejandría. El reconocimiento de patrones, que permite rápidamente a la IA registrar parecidos y diferencias para, por ejemplo, una mejor orientación espacial manejando un mapa. Y recientemente el avance se ha producido en el procesamiento del lenguaje natural, pudiendo traducir, resumir o redactar textos de forma superior a como lo hacen los humanos. Además, estamos descubriendo la potencia de la IA en la creación de imágenes y sus capacidades artísticas, pues aprenden de estilos musicales o literarios previos y pueden componer música o escribir poesía de forma «creativa». Algunas tareas que identificábamos como creativas se pueden generar con IA, mediante la combinación de elementos que participaron en su aprendizaje, como hacemos nosotros mismos.

Inteligencia humana

Los críticos con la IA dicen que su uso nos impide desarrollar algunas capacidades mentales humanas, como la lectura, la reflexión, la memoria, la escritura, etc. Debemos admitir que la mente es un elemento fundamental en el desarrollo del ser humano. En las tradiciones esotéricas se sugiere que la «chispa divina» o chispa mental es esencial en la naturaleza humana, y que la tarea del ser humano es descubrir y cultivar este talento mediante la práctica espiritual y la búsqueda de la verdad. Si perdemos nuestras aptitudes mentales, podríamos ser «menos humanos». Pero las máquinas no tienen esos conceptos de la finalidad o de la trascendencia.

Nos creíamos los únicos seres inteligentes, pues aunque podamos decir que los animales tienen en ocasiones un comportamiento inteligente, no son conscientes de ello. Ahí es donde radica la diferencia. Las máquinas con IA, aunque sean tan inteligentes o más que nosotros, no son conscientes de su propio funcionamiento, ni son capaces de tomar decisiones independientes. Son herramientas que pueden ser utilizadas por los seres humanos para lograr objetivos específicos, pero no tienen una comprensión de sí mismas o del mundo que las rodea. La IA no es algo que pueda reemplazar a los humanos, sino que es una mera extensión de nosotros mismos. Es un conjunto de recursos de programación muy avanzados, pero no se parece al conocimiento humano. El ser humano no es una computadora.

Quienes se asombran de las capacidades inteligentes de la IA es porque solo ponen el foco en la abstracción y el razonamiento, en detrimento de otros aspectos humanos. Nos estaríamos olvidando de la inteligencia emocional o de la inteligencia social. En este sentido, se podría afirmar que las máquinas no son inteligentes, si entendemos por inteligencia la capacidad de elegir entre diferentes opciones o situaciones, comprenderlas y realizar una síntesis para valorar cuál es la más conveniente para tomar la decisión adecuada. Los seres humanos tenemos creatividad, imaginación, empatía, pensamiento crítico, curiosidad y pasión, elementos que no posee la IA.

La IA está diseñada para procesar información a través de un conjunto de instrucciones lógicas y matemáticas. Los sistemas con IA solo pueden operar según su programación, pues son deterministas y no pueden tomar decisiones autónomas o creativas más allá de lo programado. Los seres humanos aprendemos a través de experiencias subjetivas y la exploración del mundo, pero la IA solo utiliza patrones matemáticos y estadísticos. Además, las máquinas no tienen intenciones ni propósitos; solo pueden operar en función de las instrucciones que se les han dado. No tienen objetivos o deseos como los seres humanos.

El mal uso de la IA en la sociedad puede conducir a efectos indeseados. Recordemos el caso de Cambridge Analytics y Facebook, para influir en varias elecciones y referendos políticos. Además, no podemos obviar que algunos buscadores de Internet con IA se han convertido en una «máquina de la verdad»[3]. Hemos de mencionar también la implantación, en la República Popular China, de un sistema universal de puntos (el llamado «Sistema de Crédito Social»). Con este sistema de IA se evalúa y controla el comportamiento de los ciudadanos y las empresas en varios aspectos de la vida cotidiana, como las finanzas, la educación, la seguridad, la salud y la moralidad. El sistema otorga puntos a los ciudadanos y empresas en función de su comportamiento, y estos puntos pueden ser utilizados para obtener beneficios, como el acceso a servicios públicos, préstamos, empleo y viajes.

Y sin embargo, pese a todos nuestros recelos, tenemos que admitir que su objetividad, capacidad de cálculo, de tener en cuenta innumerables factores en la toma de decisiones, etc., podría ser de gran ayuda para la organización de nuestra sociedad. Porque estas IA, si son más inteligentes, más racionales, con menos fallos, sin subjetivismos, sin prejuicios, podrían ser más justas que nosotros e incluso gobernar o ayudar a gobernar nuestra sociedad. Y podrían conducir nuestros vehículos con menos accidentes que nosotros.

Además, por su capacidad de estar siempre dispuestas y poder comunicarse con nosotros, quizás podrían ser nuestros acompañantes, o al menos el de los cientos de millones de ancianos que viven en soledad en este mundo tan deshumanizado. Esto ya está ocurriendo en Japón, por ejemplo. Curiosamente, la excesiva tecnificación de la sociedad nos ha convertido en seres más aislados, más solitarios y, sin embargo, el remedio podría ser precisamente implementar más tecnología.

La conclusión es que necesitamos una «IA amigable[4]» en la que se tengan en cuenta las consecuencias a largo plazo de las acciones y decisiones de la IA. El objetivo sería crear sistemas no solo eficientes, sino también seguros y beneficiosos para la sociedad. Para ello, deben estar diseñados con valores éticos y ser capaces de aprender y adaptarse a medida que se utilizan. Y además, es preciso instar a los Gobiernos a colaborar con la comunidad científica en una legislación que proteja los derechos individuales y establezca límites penales sobre el mal uso de la IA. Esto requerirá que las empresas se sienten con instituciones y Gobiernos, psicólogos, filósofos y organizaciones de derechos humanos para garantizar que se hayan considerado todos los aspectos de esta tecnología.

[1] «Si cada instrumento pudiera realizar su propio trabajo, obedeciendo o anticipándose a la voluntad de otros, como las estatuas de Dédalo (…), si, de igual manera, el aparato tejiera y el plectro tocara la lira sin una mano que los guíe, los jefes de los obreros no querrían siervos, ni los amos esclavos». Política, cap. II «De la esclavitud».

[2] En libros con títulos tan explícitos como Armas de destrucción matemática. Cómo el Big Data aumenta la desigualdad y amenaza la democracia, de Cathy O’Neil, Algoritmos de opresión. Cómo los motores de búsqueda refuerzan el racismo, de Safiya Umoja Noble, o Datos vs democracia. Cómo los algoritmos del Big Data modelan nuestras opiniones y alteran el curso de la historia, de Kris Shaffer.

[3] Otros libros interesantes son Google y el mito del conocimiento universal, de Jean-Noël Jeanneney, o Googleados: el fin del mundo tal como lo conocíamos, de Ken Auletta.

[4] Utilizamos el término acuñado por Eliezer Yudkowsky. Podemos leerlo en https://www.kurzweilai.net/what-is-friendly-ai.

Tema muy interesante!!